ChatGPT Image vient de changer les règles de la fraude documentaire

5

min

•

24.04.2026

Il y a quelques jours, OpenAI lançait ChatGPT Images 2.0.

En moins de 12 heures, le modèle atteignait la première place dans toutes les catégories de l'Image Arena. Impressionnant.

Et pour beaucoup d'équipes compliance, risk et KYC : préoccupant.

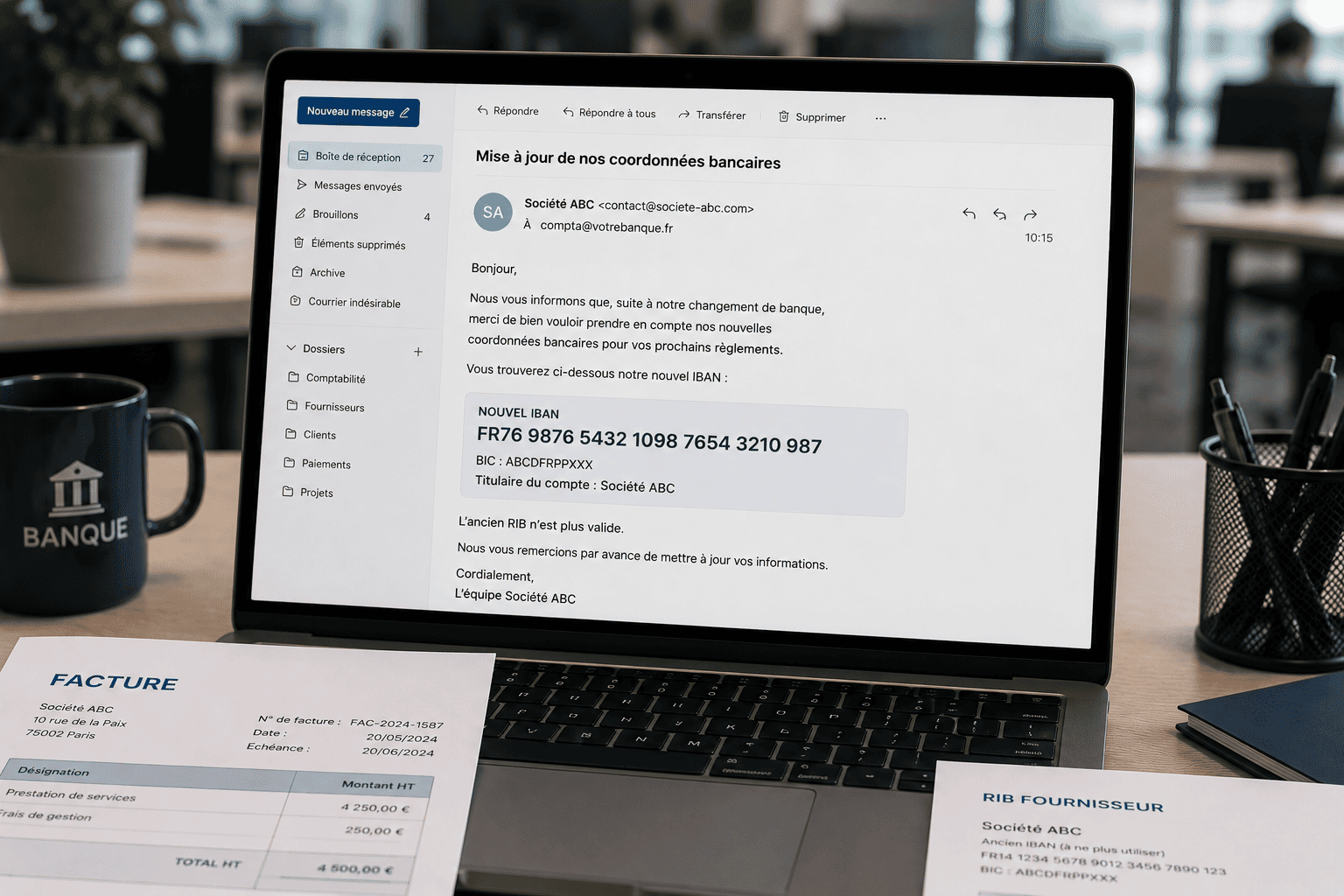

Parce que si les premières démonstrations ont montré des illustrations créatives et des visuels marketing bluffants, d'autres ont rapidement révélé un angle moins reluisant : la capacité du modèle à générer des documents d'identité d'une précision déconcertante.

Passeports, permis de conduire, cartes de résidence, chèques bancaires. Le tout en quelques instructions, sans compétences techniques, et gratuitement.

Ce n'est pas une hypothèse. Des exemples ont circulé sur les réseaux sociaux dès le lendemain du lancement.

Ce qui a réellement changé

La fraude documentaire n'est pas nouvelle. Ce qui change, c'est le seuil d'entrée.

Jusqu'à récemment, produire un faux document convaincant demandait du temps, des outils spécialisés, et un certain niveau d'expertise. Les barrières à l'entrée limitaient naturellement le volume et la sophistication des tentatives.

Avec les générateurs d'images de nouvelle génération, ces barrières s'effondrent.

En 2025, 2 % des faux documents détectés étaient déjà générés par IA générative. Ce chiffre est appelé à croître significativement.ChatGPT Images 2.0 est accessible gratuitement. Il ne demande aucune compétence technique. Et il produit un résultat en quelques secondes.

Ce n'est plus une menace de niche. C'est une menace de masse.

Les systèmes de vérification classiques face au mur

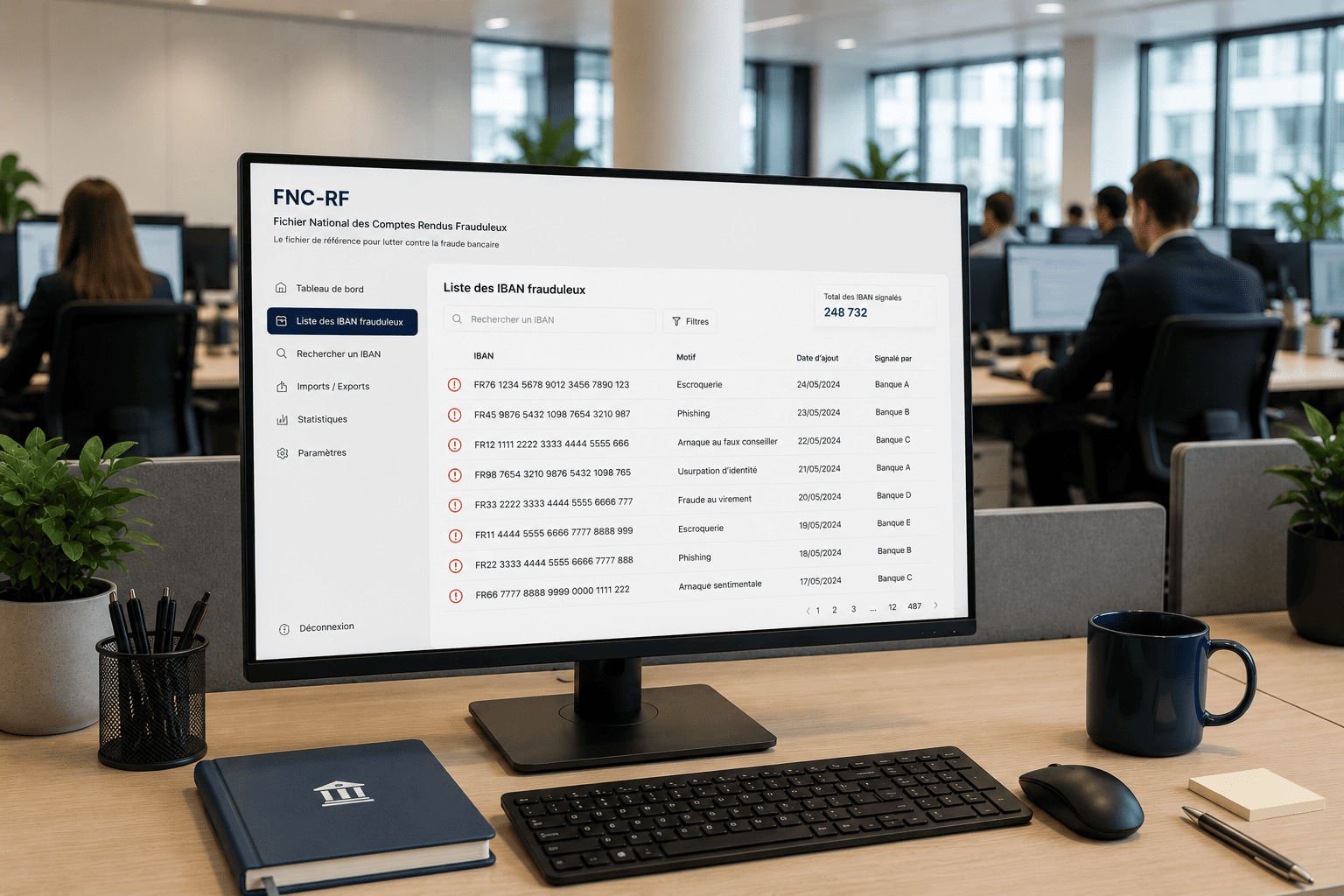

Le problème profond n'est pas l'existence de faux documents. C'est que les systèmes automatisés conçus pour les détecter ont été entraînés sur des faux d'une autre génération.

Un faux document produit par un logiciel de retouche présente des artefacts prévisibles : incohérences de pixels, polices approximatives, signatures peu crédibles. Les algorithmes de détection ont appris à repérer ces signaux.

Un faux généré par ChatGPT Images 2.0 ne présente pas les mêmes failles.

La typographie est correcte. Le QR code est présent. La mise en page respecte les standards officiels. Le résultat est, dans certains cas, indiscernable d'un document authentique à l'oeil nu — et parfois pour les outils automatisés.

C'est là que réside la rupture : non pas dans la qualité du faux, mais dans l'inadéquation entre la menace actuelle et les défenses héritées du passé.

Ce que ça implique concrètement pour les entreprises

Pour les équipes qui opèrent des processus d'onboarding, de crédit, d'assurance ou de ressources humaines, les conséquences sont directes.

Les contrôles documentaires seuls ne suffisent plus.

Vérifier qu'un document a l'air authentique n'est plus une garantie suffisante. Il faut croiser cette vérification avec d'autres sources de données, comportementales, financières, contextuelles, pour établir une confiance réelle.

La vitesse de la fraude dépasse celle de la mise à jour des outils.

Les modèles de détection doivent être réentraînés régulièrement. Les équipes risk doivent s'attendre à une course permanente entre attaquants et défenseurs.

L'humain reste un maillon critique.

Les faux documents générés par IA ciblent souvent les étapes où un humain valide une exception : support client, back-office KYC, équipes de crédit. La sensibilisation interne devient une composante à part entière du dispositif anti-fraude.

Vers une approche de vérification multicouche

Face à cette évolution, la réponse ne peut pas être uniquement technologique. Elle doit être systémique.

Les organisations les plus résilientes s'orientent vers des approches qui combinent plusieurs niveaux de vérification : l'analyse documentaire, certes, mais aussi la cohérence des données déclarées avec des sources tierces, l'analyse comportementale du parcours utilisateur, et la contextualisation de chaque vérification dans un historique plus large.

L'objectif n'est pas de rendre la fraude impossible. L'objectif est de la rendre suffisamment coûteuse, complexe et risquée pour décourager la grande majorité des tentatives.

Ce changement de paradigme suppose aussi une évolution côté réglementation. La directive DSP3 pousse dans cette direction : vers des exigences de vérification plus robustes, plus continues, et moins dépendantes du seul document comme preuve d'identité.

Ce qu'on retient

L'émergence de ChatGPT Images 2.0 n'est pas un événement isolé.

C'est un signal parmi d'autres d'une tendance de fond : l'IA générative abaisse continuellement le coût et la complexité de la fraude.

Pour les entreprises qui opèrent dans des environnements régulés ou à risque, la question n'est plus de savoir si leurs processus seront challengés. Mais quand, et avec quelle préparation.

La réponse viendra de celles qui auront su passer d'une logique de vérification à une logique de compréhension : comprendre qui est vraiment la personne en face, pas seulement si son document a l'air valide.

Découvrez les solutions KYC de Meelo

Fraude documentaire, vérification biométrique, liveness detection. Meelo analyse chaque document d'identité en moins de 5 secondes